Rozwiązania wykorzystujące sztuczną inteligencję, takie jak planowany system AI wspomagający orzecznictwo lekarskie w ZUS, przesuwają granice cyfryzacji usług publicznych w bardzo wrażliwym społecznie obszarze. Teza, którą stawiam na wstępie, brzmi: Automatyczna analiza danych przez AI w ZUS nie zmieni istoty decyzji medycznych, ale głębiej niż dotychczas zmusi do pytań o zaufanie, odpowiedzialność i rzeczywisty wpływ cyfrowych narzędzi na relacje między urzędnikiem, specjalistą, a obywatelem. Sztuczna inteligencja, rozumiana tu jako zestaw algorytmów analizujących ogromne ilości rozproszonych danych, nie zastępuje lekarza w wydawaniu decyzji. Służy wsparciu – przekształca nieuporządkowane akta w przejrzystą strukturę, wyciągając fakty, porządkując je tematycznie i chronologicznie. Jednak nawet ta „pomocniczość” staje się przedmiotem debaty: gdzie kończy się wsparcie, a zaczyna realny wpływ na decyzję?

Efektywność kontra zaufanie społeczne

Cyfryzacja orzecznictwa niesie obietnicę większej efektywności: mniej papierologii, szybszy dostęp do kluczowych danych, prostsza obsługa spraw. To cenne w środowisku, w którym orzecznicy mierzą się z zalewem niejednolitych dokumentów, a sprawność procesów wpływa bezpośrednio na losy tysięcy ludzi. Trzeba jednak postawić ważne pytanie: czy w tej optymalizacji nie zgubi się ludzki wymiar procesu decyzyjnego?

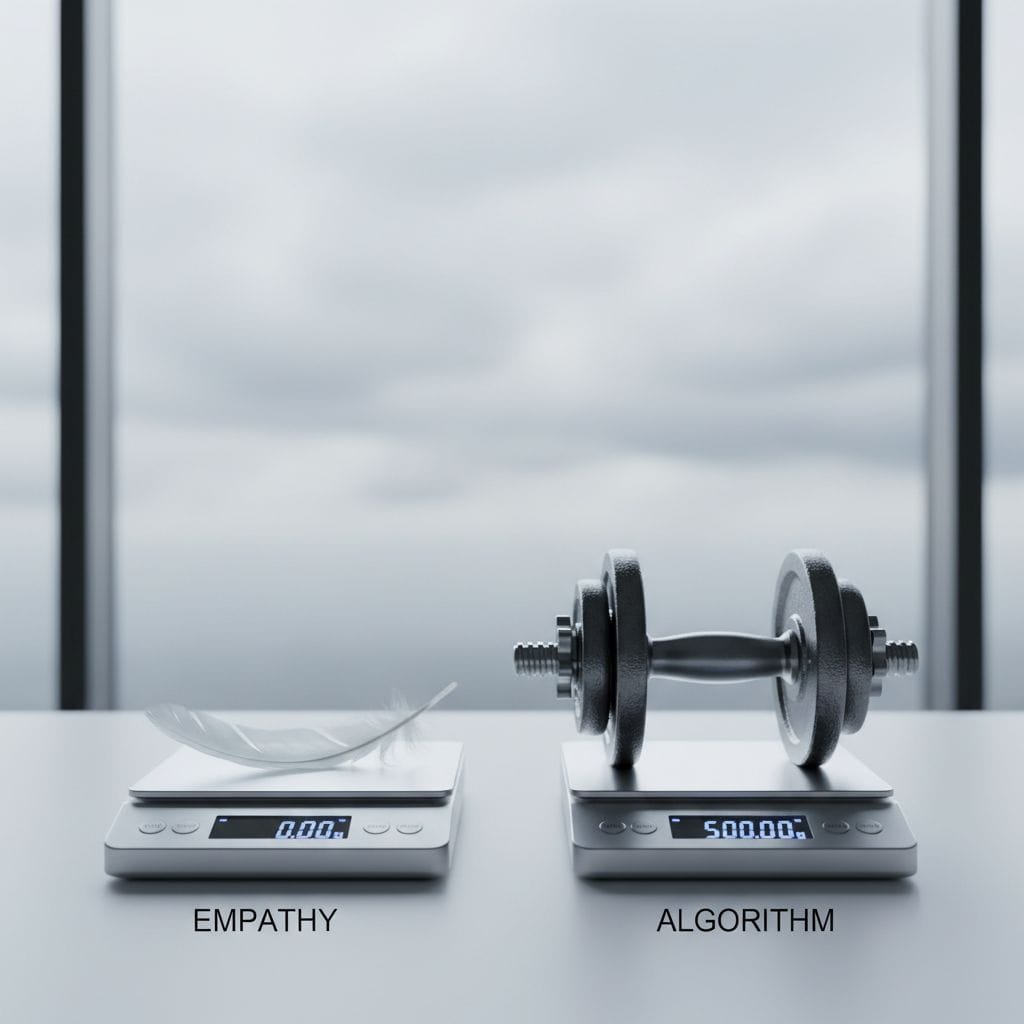

Wielu obywateli oczekuje wrażliwości i indywidualnego podejścia od systemów oceniających ich stan zdrowia czy sytuację zawodową. „Empatyczna ocena ludzka” to pojęcie nieostre, lecz dobrze oddające obawy związane ze zbytnim zautomatyzowaniem decyzji, nawet w sytuacji, gdy AI jedynie ułatwia pracę człowieka. Szczególnie ważne staje się jasne określenie granic działania AI – deklaracje o jej pomocniczej roli są politycznie bezpieczne, ale realnie nie eliminują ryzyka dryfu w stronę dalszej automatyzacji.

Regulacje, przejrzystość i granice technologii

Na korzyść wdrożenia technologii przemawia fakt, że system ma być projektowany zgodnie z RODO i najnowszymi unijnymi regulacjami, takimi jak AI Act. To oferuje formalne narzędzia kontroli, testowania (np. względem halucynacji modeli generatywnych), audytowania i zapewnienia przejrzystości. Jednak nawet najlepiej opisane procedury nie odpowiedzą na wszystkie pytania praktyczne:

- Jak faktycznie zmieni się codzienna praktyka pracy lekarzy orzeczników?

- Czy presja efektywności może mimowolnie przesunąć odpowiedzialność za interpretację danych na system, a nie człowieka?

- Jaka będzie percepcja społeczna rozstrzygnięć wspieranych przez narzędzia AI – czy wzrośnie liczba odwołań i poczucie dehumanizacji systemu?

Brak rzetelnych i publicznie dostępnych wyników z pilotażu powoduje, że ocena wpływu AI na efektywność i zaufanie społeczne to dziś bardziej sfera oczekiwań albo obaw niż twardych danych.

Ostatecznie trend cyfrowego wspomagania decyzji medycznych przez AI w ZUS zmienia rzeczywistość użytkowników głównie w tym, że od ich spraw przetwarzanych przez automatyczne algorytmy będzie zależała przejrzystość, a nie treść decyzji – o ile granice wsparcia pozostaną czytelne i skutecznie pilnowane.

Jeśli chcesz zgłębiać takie zmiany i ich konsekwencje, obserwuj portal https://sztucznainteligencjablog.pl/