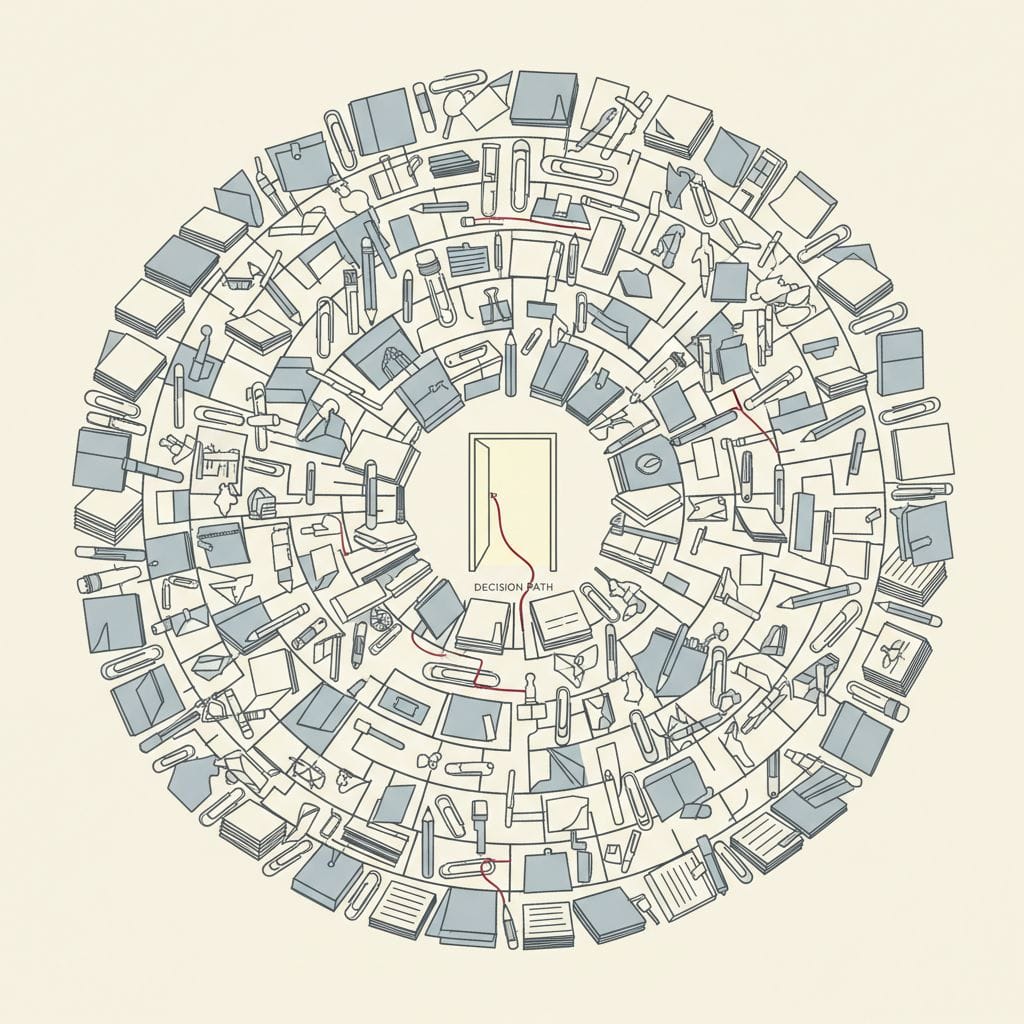

Sztuczna inteligencja coraz częściej staje się narzędziem nie tyle wspierającym, co faktycznie przewidującym decyzje – zwłaszcza na poziomie zarządzania w dużych organizacjach. Teza, którą stawiam, jest prosta: wdrożenie AI w roli predyktora budzi fundamentalne pytania o przesunięcie odpowiedzialności i redefinicję autonomii decyzyjnej menedżerów. Pod pojęciem „predyktor decyzji” rozumiem tutaj systemy oparte na AI, które nie tylko analizują dane, ale sugerują konkretne działania, często wypierając klasyczną analizę i intuicję człowieka.

Od analizowania do przewidywania: sztuczna inteligencja zmienia rolę menedżera

Zasadnicza różnica między wsparciem a zastąpieniem decyzji polega na tym, że w pierwszym scenariuszu to człowiek interpretuje dane i rekomendacje – w drugim, algorytm narzuca ścieżkę działania na bazie zaprogramowanych kryteriów. Zarządzanie przestaje być wtedy aktywnym reagowaniem i poszukiwaniem rozwiązań, a raczej kontrolą poprawności parametrów wejściowych i oceny ryzyka, które są „podane na tacy”. W efekcie, czas reakcji na zmianę sytuacji biznesowej skraca się, ale sam proces zaczyna przypominać konfigurację ustawień w systemie, a nie kreatywną odpowiedź na nieprzewidywalność otoczenia.

Można to sprowadzić do pytania: czy menedżerowie, korzystając na co dzień z generatywnej AI, realnie tracą część sprawczości na rzecz algorytmów? Czy ich rola ogranicza się tylko do walidacji i zatwierdzania wyliczeń, czy może przesuwa się w stronę projektowania sensownych zadań wejściowych dla systemów i oceny skutków ubocznych?

Konsekwencje: odpowiedzialność, autonomia i nowe napięcia

Kluczowe następstwa tej zmiany widoczne są na dwóch poziomach:

- Odpowiedzialność za decyzję: Skoro AI przewiduje określone scenariusze i sugeruje działania, miejsce odpowiedzialności przesuwa się: nie za „samą decyzję”, a za to, jakie dane algorytmy otrzymały oraz jak je nadzorowano. Błąd ludzki zamienia się na błąd systemowy lub błędną interpretację podpowiedzi AI.

- Autonomia pracowników: Poziom zaufania do algorytmicznej trafności determinuje, czy osoby decyzyjne mogą jeszcze kwestionować wyniki AI, czy akceptują je jako „obiektywny opis rzeczywistości”. To rodzi napięcie między bezpieczeństwem, jakie dają predykcje, a zgubą dla inicjatywy i eksperymentowania.

Nie można tu pominąć ryzyka uproszczeń: szybki wzrost efektywności operacyjnej to realna korzyść, ale skłonność do automatyzowania decyzji może prowadzić do erozji kompetencji własnych zespołów. Organizacje muszą więc nauczyć się zarządzać nie tylko wydajnością AI, lecz także nową odpowiedzialnością oraz odpornością na bezkrytyczne zaufanie do wygenerowanych rekomendacji.

W praktyce oznacza to, że największą zmianą dla organizacji nie jest dziś automatyzacja decyzji, ale konieczność przemyślenia, kto i na jakich zasadach decyduje o ostatecznym kształcie procesu – i jaka jest w tym rola człowieka.

Obserwując ten trend, organizacje stoją przed zadaniem zdefiniowania na nowo granic autonomii i kontroli tam, gdzie AI przewiduje przyszłość szybciej niż ludzka intuicja.

Zachęcam do śledzenia kolejnych analiz na https://sztucznainteligencjablog.pl/ – razem demaskujemy realne konsekwencje rewolucji algorytmicznej.