Codzienna bankowość coraz szybciej przesuwa się w stronę modelu AI-first, w którym hybrydowe agenty – zaawansowane oprogramowanie wyposażone w sztuczną inteligencję i pewien poziom samodzielności – przejmują inicjatywę w procesach decyzyjnych i obsługowych. Hybrydowy agent w banku to nie tylko chatbot odpowiadający na pytania. To narzędzie, które gromadzi dane, analizuje oferty, inicjuje transakcje i przekazuje klientowi do zatwierdzenia już gotową decyzję. Teza, która wydaje się najbardziej istotna dziś, nie dotyczy efektywności czy wygody tego rozwiązania, lecz przejrzystości podziału odpowiedzialności: czy zatwierdzenie przez człowieka procesu w pełni przygotowanego przez AI rzeczywiście oznacza ludzką kontrolę, czy tylko jej pozór?

Ludzka rola w automatycznym świecie

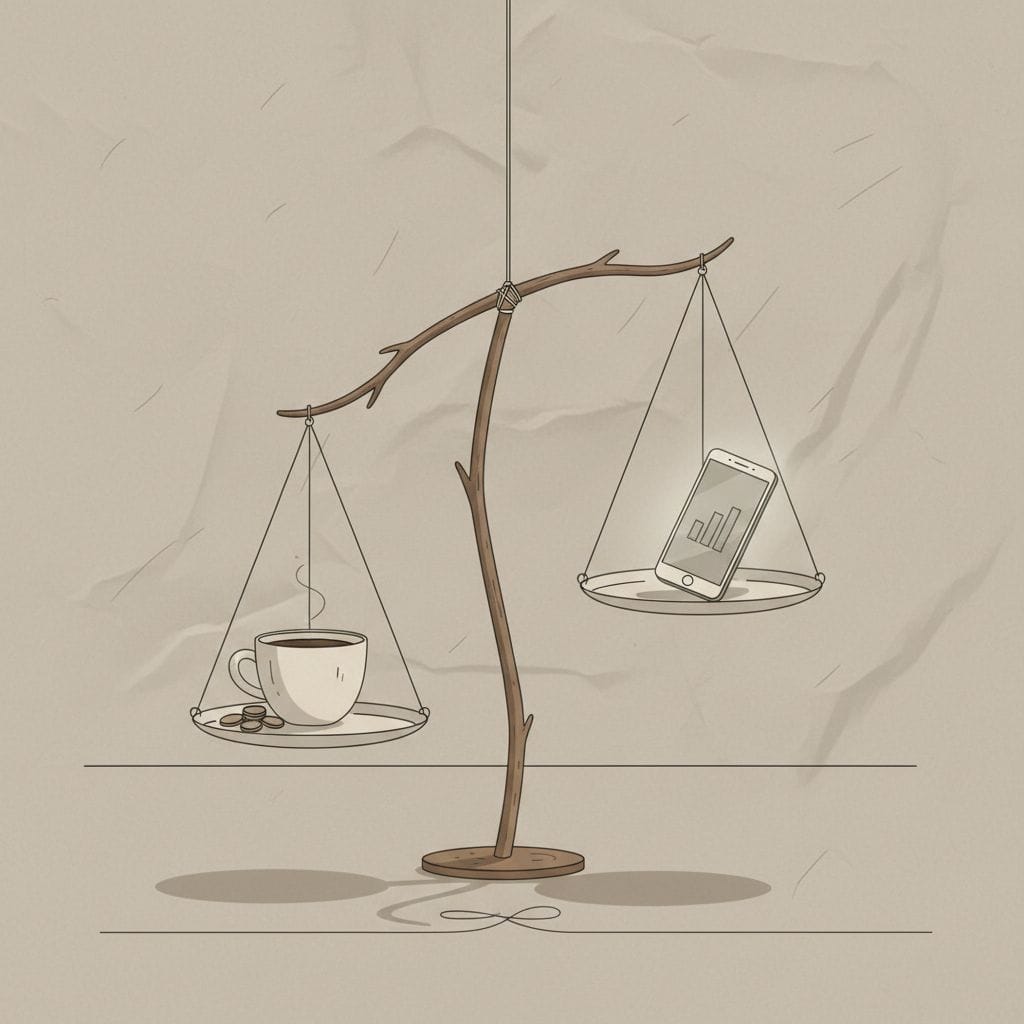

Automatyzacja, jaka postępuje w bankowości, opiera się obecnie głównie na modelu „człowiek w pętli” (Human-in-the-Loop). W teorii ma to oznaczać, że kluczowe decyzje są zawsze zatwierdzane przez pracownika lub klienta – dotyczy to choćby transakcji, oceny ryzyka czy procedur zgodności (compliance). Jednak w praktyce człowiek sprowadzany jest coraz częściej do akceptowania tysięcy działań podejmowanych przez agentów AI w tle. Trudno tu mówić o świadomym, indywidualnym nadzorze, a raczej o automatycznym „klikaniu OK”, co przypomina bardziej formalność niż rzeczywistą kontrolę.

To nie tylko kwestia ergonomii czy szybkości podejmowania decyzji. Chodzi o odpowiedź na pytanie, kto faktycznie ponosi odpowiedzialność za błędy lub nadużycia – szczególnie w sytuacji, gdy procesy back-office i compliance są zautomatyzowane, a ogrom decyzji przechodzi przez algorytmy, a nie przez ludzką analizę.

Odpowiedzialność, zaufanie i wykluczenie cyfrowe

Część technicznych barier właśnie znika – wdrożone przez Visa i Mastercard protokoły dla agentów AI sprawiają, że zaufani agenci mogą legalnie sygnalizować zamiar transakcji i bezpiecznie przesyłać dane uwierzytelniające. Jednak to nie rozwiązuje bardziej złożonych problemów związanych z prawem, odpowiedzialnością czy zrozumieniem procesu przez użytkowników.

W praktyce:

- Nie wiadomo, kto odpowiada za działanie agenta: bank, twórca algorytmu, czy klient, który zatwierdza gotowe propozycje.

- Potwierdzanie transakcji przez użytkownika nie musi oznaczać faktycznego zrozumienia, na czym ta transakcja polega, zwłaszcza gdy system działa warstwowo lub integruje wiele usług w jednej superaplikacji.

- Systemy tego typu mogą (jeszcze mocniej niż dziś) wykluczać osoby niedoświadczone cyfrowo lub obawiające się nowych technologii – jeśli potwierdzenie wymaga aplikacji mobilnej lub pełnej integracji online.

Niepewność co do odpowiedzialności to nie drobna luka regulacyjna, lecz fundamentalny problem dla całego rynku. Zbyt łatwo mogłoby się okazać, że „zatwierdzenie” to po prostu kliknięcie polecenia bez świadomości skutków. Tymczasem prawdziwe bezpieczeństwo i zaufanie w bankowości buduje się nie na formalnym potwierdzeniu, lecz na jasnym podziale ról, odpowiedzialności oraz właściwej edukacji klienta i pracownika.

Realny wpływ AI-first w bankowości to fundamentalna zmiana w rozumieniu nadzoru, kontroli i odpowiedzialności – nie tylko automatyzacja procesu. Kto ponosi odpowiedzialność – ten powinien mieć też realną kontrolę, a nie tylko dostęp do przycisku „OK”.

Chcesz wiedzieć więcej o rzeczywistych konsekwencjach wdrożeń AI? Zajrzyj na https://sztucznainteligencjablog.pl/ – będziemy analizować dalej.