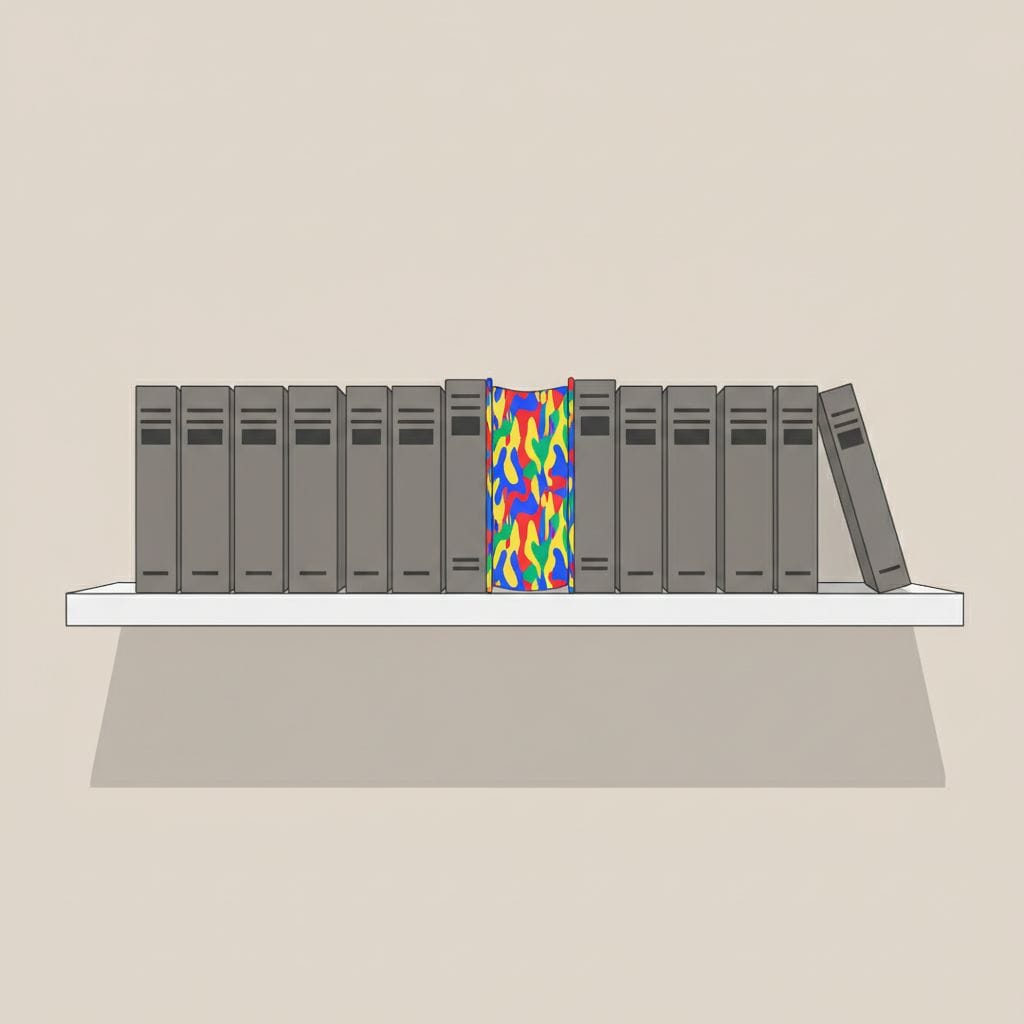

Rola AI w przetwarzaniu języka naturalnego – w tym narzędzi takich jak ChatGPT czy systemów tłumaczeń automatycznych – pociąga za sobą ryzyko homogenizacji językowej, czyli ujednolicenia sposobu wyrażania myśli w tekstach generowanych automatycznie. Homogenizacja językowa to zjawisko, w którym odrębne, kulturowo zróżnicowane sposoby mówienia i pisania ustępują miejsca jednym, dominującym wzorcom – często uproszczonym i pozbawionym indywidualnego charakteru. Teza, którą stawiam, brzmi: narzędzia AI już dziś kształtują język masowej komunikacji, prowadząc do zwiększonej powtarzalności i ujednolicenia, ale pełne konsekwencje tej zmiany pozostają nieznane i budzą uzasadnione obawy o przyszłość twórczości oraz debaty publicznej.

Gdzie realnie widać homogenizację językową?

Już w tej chwili nietrudno zauważyć, że teksty generowane przez AI zdradzają pewne schematy: powtarzające się konstrukcje, przewidywalny dobór słów, a także brak osobistego, wyrazistego stylu. Dzieje się tak, ponieważ AI nie tworzy myśli samodzielnie – korzysta z ogromnych zbiorów danych i działa na zasadzie statystyk, kalkulując najbardziej prawdopodobne słowa i frazy na podstawie wcześniej "przeczytanych" tekstów. To samo dotyczy tłumaczeń: coraz powszechniejsza automatyzacja wyraźnie spłaszcza bogactwo interpretacyjne, jakie niesie żywy język.

Z perspektywy organizacji, ten trend niesie konkretne skutki:

- Teksty AI stają się do siebie podobne, tracąc niuanse, które decydowały o rozpoznawalności czy oryginalności komunikatów.

- Języki i dialekty mniejszościowe mogą być marginalizowane, bo algorytmy preferują najbardziej popularne warianty.

- Różnorodność opinii w debacie publicznej może zostać ograniczona – jeśli rekomendacje AI promują powtarzające się, przewidywalne argumenty.

Skala i znaczenie zagrożenia – gdzie kończy się wiedza, a zaczyna spekulacja?

Choć zjawisko powtarzalności jest dość dobrze udokumentowane, to skala wpływu AI na szeroko rozumianą kreatywność czy poziom dyskusji publicznej jest na razie trudna do precyzyjnego oszacowania. Liczne artykuły i debaty zwracają uwagę, że wciąż nie mamy twardych danych, na ile "utrata unikalności" przesądza o jakości tekstów lub samej tkanki społecznej.

Warto przy tym uważać na pewne uproszczenia:

- Nie każde zastosowanie AI równa się powtarzalności – ich efekty zależą od kontekstu, danych źródłowych i zastosowanych algorytmów.

- Debaty o dominacji AI często przeceniają aktualną skalę zjawiska, zakładając, że zmiany są już wszechobecne, choć opieramy się głównie na jakościowych obserwacjach, nie liczbach.

Mimo wielu niejasności, znaczenie problemu pozostaje niebagatelne: chodzi o to, czy masowe korzystanie z tekstów generowanych przez AI oddziaływa nie tylko na kształt języka, ale i na zdolność użytkowników i organizacji do twórczego i zniuansowanego komunikowania się.

Dla organizacji i użytkowników trend ten oznacza konieczność uważnego balansowania między efektywnością narzędzi AI a świadomą troską o zachowanie żywego, różnorodnego języka – bo automatyczne generowanie treści przestaje być tylko techniczną innowacją, a zaczyna realnie kształtować samą tkankę komunikacji.

Śledź dalsze analizy na https://sztucznainteligencjablog.pl/ – bo to, co dzieje się w języku, dotyczy każdego z nas.